L’intelligenza artificiale non è il futuro. È già nei processi, nelle decisioni, nei prodotti. Eppure, nelle organizzazioni, continua a essere trattata come un tema da “gestire” più che da governare. L’AI Act non cambia solo il perimetro normativo, espone una fragilità strutturale: molte organizzazioni non sanno ancora chi decide sul dato. E quindi, inevitabilmente, non sanno chi decide sull’AI.

Il rischio non è l’errore è l’ambiguità. È da qui che prende forma il confronto promosso da ComplianceDesign.it, sviluppato a partire dalla survey realizzata con EQS Group Italia e ospitato da Norton Rose Fulbright. Un confronto moderato da Elena Maderna, Group Data Protection Officer del Gruppo San Donato, che ha visto il contributo di Matteo Pedica, Head of Integrated Compliance & DPO di Fastweb, Tommaso Sala, Head of Data Protection Regulation di Mediobanca, e Francesco Gelmetti, Legal Consultant di Norton Rose Fulbright.

Un dialogo che non si limita a leggere i dati, ma li utilizza per porre una domanda più scomoda: stiamo costruendo una governance dell’AI o stiamo semplicemente aggiungendo un ulteriore livello di compliance?

Il falso problema: non manca la norma, manca la decisione

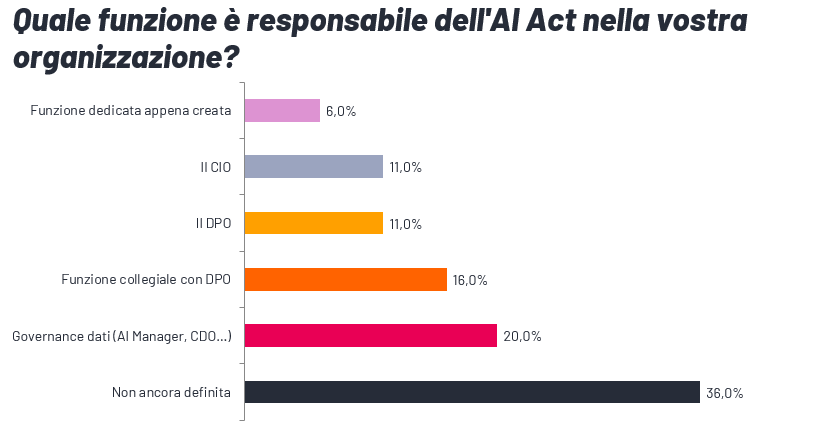

Nel 36% delle organizzazioni la responsabilità sull’AI Act non è definita . La lettura più comoda è dire che manca chiarezza normativa ma quella più onesta potrebbe essere un’altra: manca la volontà di decidere. Perché decidere significa esporsi. Significa stabilire chi blocca, chi autorizza, chi si assume il rischio. E questo, nelle organizzazioni, è sempre stato il passaggio più difficile.

L’AI Act, nella sua essenza, richiede prima di tutto consapevolezza: sapere dove l’intelligenza artificiale è utilizzata, con quali dati e con quali impatti. Tuttavia, anche questo livello minimo fatica ancora a essere pienamente consolidato. Non è un problema di interpretazione normativa, ma a una questione più profonda di accountability.

Centralizzare o distribuire?

L’intelligenza artificiale non è un dominio separato. Attraversa marketing, operations, IT, legal e risk. Per questo motivo, immaginare di “assegnarla” a una funzione specifica significa semplificare eccessivamente la realtà. L’evidenza che emerge è piuttosto quella di un modello ibrido, in cui esiste una regia centrale ma la responsabilità è necessariamente diffusa lungo i processi.

In questo contesto, il ruolo del DPO resta centrale ma deve essere mantenuto nel suo perimetro. Coinvolgerlo è inevitabile, ma trasformarlo nel punto di raccolta di tutte le tematiche legate all’AI rischia di indebolire sia la funzione privacy sia la governance complessiva. Il tema non è trovare “chi se ne occupa”, ma costruire un modello che tenga insieme competenze diverse senza sovraccaricarne una sola.

Classificare il rischio: il vero momento della verità

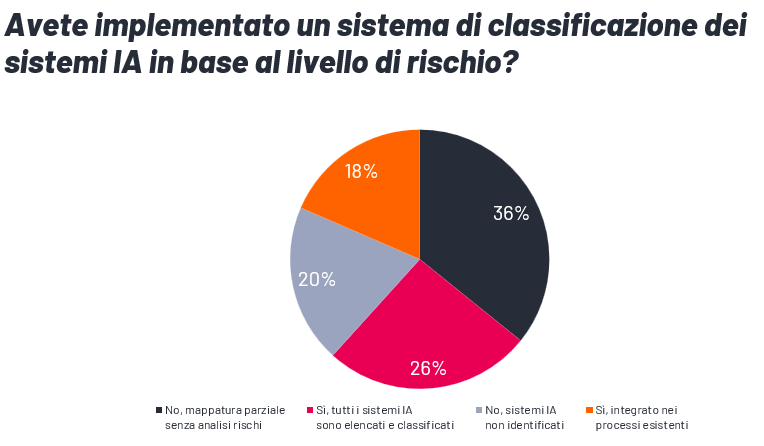

La classificazione del rischio rappresenta probabilmente il passaggio più critico. Non tanto per la sua complessità tecnica, quanto per le implicazioni che comporta.

I dati mostrano chiaramente come molte organizzazioni siano ancora ferme a mappature parziali o incomplete . Ma la difficoltà non è solo legata alla natura delle tecnologie, spesso opache o difficili da interpretare. Classificare significa esplicitare un livello di rischio e, quindi, prendere una posizione.

Finché il confronto resta su principi generali, come etica o trasparenza, il consenso è ampio. Quando però si passa alla valutazione concreta, emergono le vere criticità. A questo si aggiunge un ulteriore elemento: la difficoltà di comprendere fino in fondo il funzionamento dei sistemi utilizzati, spesso basati su modelli che non sono pienamente trasparenti.

Il risultato è che la classificazione rischia di diventare un esercizio formale. Tuttavia, il nodo principale non è tanto come classificare, quanto essere certi di cosa si sta classificando. Senza una mappatura reale dei sistemi, qualsiasi analisi del rischio resta incompleta.

Shadow AI: il rischio non è dove lo cerchiamo

L’intelligenza artificiale non entra nelle aziende solo attraverso grandi progetti. Entra silenziosamente: tool acquistati, funzionalità integrate nei software, soluzioni adottate dalle singole funzioni. La vera esposizione è spesso fuori dal radar.

È qui che si concentra il rischio più sottovalutato: la shadow AI. Non governare questo fenomeno significa perdere il controllo non solo sulla tecnologia, ma soprattutto sui dati.

E sui flussi che quei dati generano, spesso verso l’esterno. Il tema non è cosa sviluppiamo. È cosa utilizziamo senza saperlo davvero.

AI e privacy: integrazione o sovrapposizione?

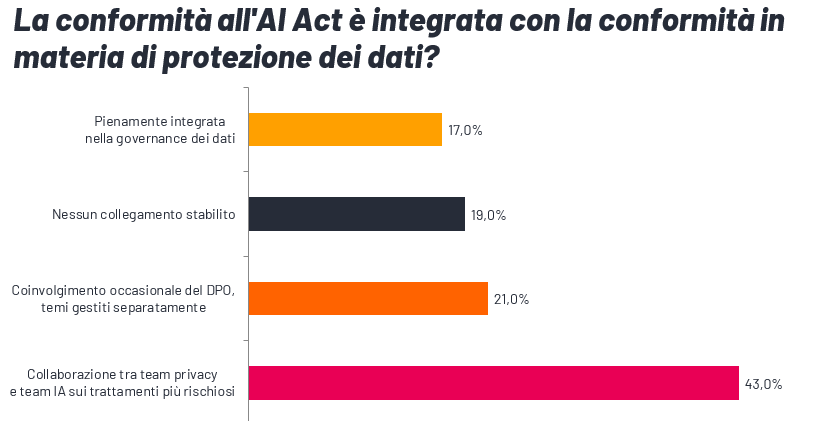

Molte organizzazioni stanno affrontando AI e privacy come due ambiti distinti. Il risultato è prevedibile: un nuovo layer di compliance che si somma a quelli esistenti. Ma sovrapporre non è governare. Se AI, data protection e data governance restano separati, il sistema si appesantisce senza diventare più efficace. Si moltiplicano controlli, policy, funzioni. Ma non aumenta la capacità decisionale.

L’AI Act, da questo punto di vista, è un test della maturità organizzativa. O si coglie l’occasione per integrare, oppure si costruisce l’ennesima architettura formale.

La vera domanda: chi decide sul dato?

L’AI Act non introduce soltanto nuovi obblighi, ma porta alla luce una domanda che molte organizzazioni hanno evitato di affrontare fino in fondo: chi decide sul dato? Senza una risposta chiara a questa domanda, qualsiasi modello di governance dell’intelligenza artificiale rischia di restare incompleto. L’AI, infatti, non è altro che un’estensione delle decisioni basate sul dato. Se il dato non è governato, l’intelligenza artificiale amplifica semplicemente le criticità esistenti. Molte organizzazioni non stanno ancora costruendo una governance, ma stanno cercando un proprietario del tema.

Da dove partire (davvero)

Non servono modelli perfetti. Servono scelte: sapere dove l’AI è utilizzata, capire con quali dati e introdurre trasparenza nei rapporti con fornitori e consulenti. Sono passaggi semplici, ma sono quelli che mancano più spesso. Il vero errore oggi non è sbagliare approccio, è restare fermi.

Oltre la compliance: la governance come leva

Quello che emerge dal confronto non è un ritardo tecnologico ma di governance. L’intelligenza artificiale è già operativa, mentre i modelli organizzativi che dovrebbero sostenerla sono ancora in fase di definizione. L’AI Act non rappresenta quindi un punto di arrivo, ma un acceleratore. Rende esplicite dinamiche che prima potevano restare implicite e costringe le organizzazioni a prendere posizione.

Per questo motivo, il passaggio richiesto non è semplicemente da non compliance a compliance, ma da compliance a governance. Una transizione che implica un cambio di prospettiva: non limitarsi a rispettare regole, ma sviluppare la capacità di decidere in modo consapevole sul dato e sull’intelligenza artificiale.

Ed è proprio su questa capacità che si giocherà, nei prossimi anni, la reale maturità delle organizzazioni.